📥researchmap業績登録の選択肢整理と、個人ユーザー向けPlaywright実装

researchmapには公式の書き込みAPIとCSV/JSON/JSONLインポート機能が用意されていますが、個人ユーザーから見るとそれぞれ制約があります。本記事では選択肢を整理した上で、完全自動化とPDF添付に対応するPlaywrightスクリプトの実装を紹介します。

researchmapには公式の書き込みAPIとCSV/JSON/JSONLインポート機能が用意されていますが、個人ユーザーから見るとそれぞれ制約があります。本記事では選択肢を整理した上で、完全自動化とPDF添付に対応するPlaywrightスクリプトの実装を紹介します。

調整さん(chouseisan.com)の出欠回答を Playwright で自動入力し、◯/△/× の判定は Google カレンダーと照合して Claude Code(claude.ai Google Calendar MCP 経由)に任せる構成を作成した記録です。fetch / fill / submit の3段階に分け、判定ルールは CLAUDE.md に記述する形にしました。

App Store審査でリジェクトされた後のビルド差し替え・スクリーンショット更新・再提出の全工程をApp Store Connect APIで実行した記録

ジャパンサーチのWeb APIを使い、モチーフ検索・撮影画像での類似検索・位置情報連動などモバイル固有の機能を備えた文化資源探索アプリの開発記録

App Store Connect Sales Reports APIの日次レポート反映時刻とYouTube Data API v3のクォータリセット時刻を実際に観測した記録です。

X投稿・RSS・GitHub APIから情報を自動収集し、AIで週間まとめ記事を生成するシステムの設計と実装

XCUITestでシミュレータのスクリーンショットを撮影し、PythonのPillowでマーケティング画像を生成、App Store Connect APIでアップロードするまでの全工程をシェルスクリプト1本で自動化する方法を解説します。

researchmapでは科研費と業績の紐付けをAPI・CSVインポートで行えないため、Playwrightでブラウザ操作を自動化するスクリプトを作成した

Claude Codeの並列エージェント機能を使い、882本の技術ブログ記事から2キャラクター掛け合い解説動画を自動生成。利用制限の上位2%に到達した実体験レポート。

Three.js と @pixiv/three-vrm を使ってヘッドレス Chrome 上で VRM モデルをアニメーションさせ、VOICEVOX のリップシンクと組み合わせて VTuber 風解説動画を自動生成するパイプラインの実装メモ。

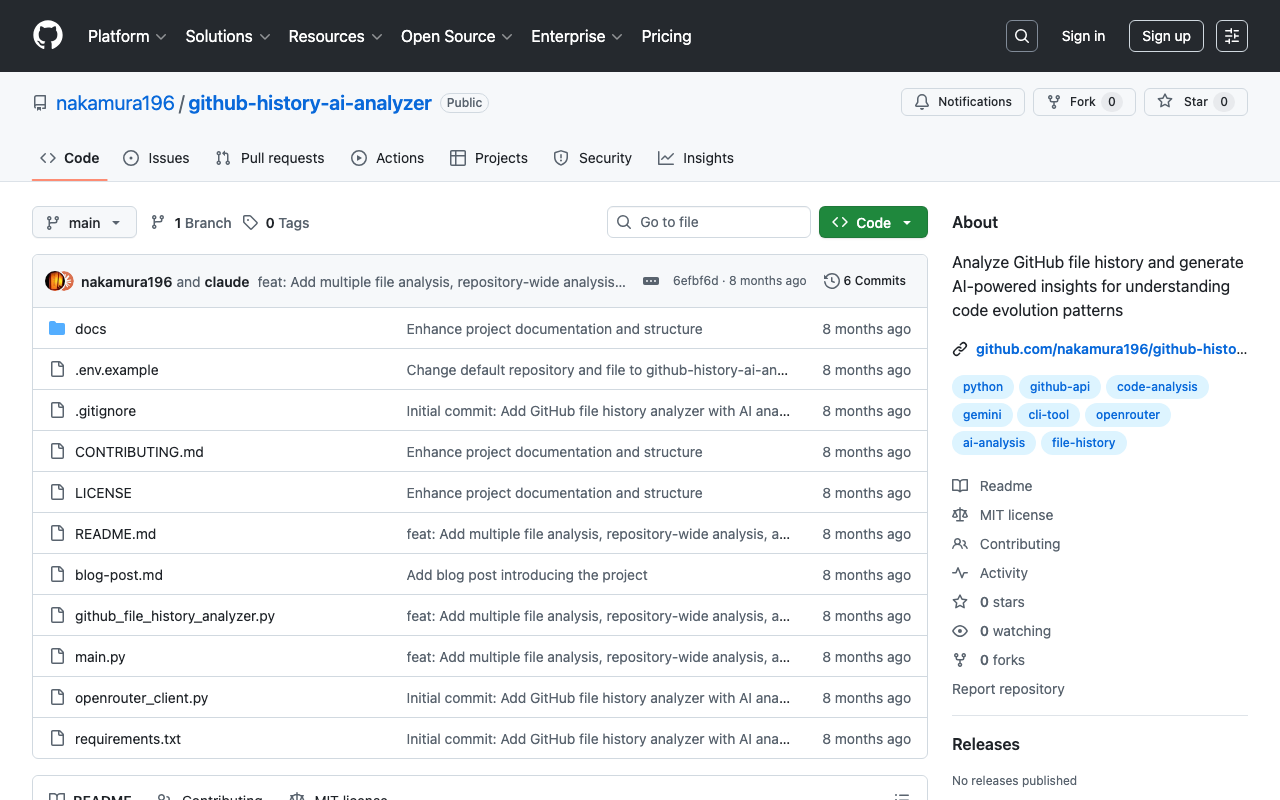

GitHub File History Analyzerの紹介:ファイル編集履歴をAIで分析するツール